Satu detik downtime bisa berarti kehilangan ribuan pelanggan. Bayangkan sebuah situs e-commerce saat flash sale atau aplikasi perbankan di tanggal gajian; lonjakan trafik yang masif bisa membuat server kewalahan dan akhirnya tumbang. Inilah masalah yang ingin dipecahkan oleh load balancing.

Bagi pengembang, administrator sistem, atau pemilik bisnis, memahami apa itu load balancing bukan lagi pilihan, melainkan sebuah keharusan untuk membangun aplikasi yang andal dan dapat diskalakan.

Artikel ini akan membahas tuntas konsep apa itu load balancing server, mulai dari cara kerjanya, jenis-jenisnya, hingga contoh arsitektur sederhana yang bisa Anda terapkan. Mari kita mulai.

Apa Itu Load Balancing?

Secara sederhana, load balancing adalah proses mendistribusikan lalu lintas (trafik) jaringan atau aplikasi secara merata ke beberapa server di belakangnya. Anggap saja load balancer sebagai seorang manajer lalu lintas yang cerdas di depan sebuah jalan tol dengan banyak gerbang. Alih-alih membiarkan semua mobil menumpuk di satu gerbang, manajer ini mengarahkan mobil ke gerbang-gerbang yang lebih sepi untuk memastikan tidak ada antrian panjang dan semua berjalan lancar.

Dalam dunia digital, “mobil” adalah permintaan dari pengguna (seperti membuka halaman web atau melakukan transaksi), dan “gerbang tol” adalah server Anda. Load balancer berada di antara pengguna dan server farm Anda, bertindak sebagai titik masuk tunggal yang kemudian menyebarkan beban kerja secara efisien.

Mengapa Load Balancing Sangat Penting?

Penerapan load balancing memberikan tiga keuntungan utama yang krusial bagi aplikasi modern:

- Peningkatan Kinerja dan Kecepatan: Dengan membagi beban kerja, tidak ada satu server pun yang terbebani secara berlebihan. Ini memastikan setiap permintaan pengguna ditangani dengan cepat, mengurangi latensi, dan meningkatkan pengalaman pengguna secara keseluruhan.

- Ketersediaan Tinggi (High Availability) dan Redundansi: Jika salah satu server Anda mengalami kegagalan (misalnya, karena masalah perangkat keras atau pemeliharaan), load balancer akan secara otomatis berhenti mengirimkan trafik ke server tersebut. Pengguna akan dialihkan ke server lain yang sehat tanpa menyadari adanya masalah. Inilah kunci dari zero downtime.

- Skalabilitas yang Fleksibel: Saat bisnis Anda tumbuh dan trafik meningkat, Anda tidak perlu mengganti server lama dengan yang lebih kuat (vertical scaling). Cukup tambahkan server baru ke dalam pool (horizontal scaling), dan load balancer akan langsung memasukkannya ke dalam rotasi distribusi trafik. Proses ini jauh lebih hemat biaya dan fleksibel.

Baca juga: Vertical vs Horizontal Scaling: Menentukan Arah Skalabilitas Infrastruktur Anda

Cara Kerja Load Balancer: Layer 4 vs. Layer 7

Load balancer tidak bekerja dengan cara yang sama. Perbedaan utamanya terletak pada lapisan (layer) Model OSI di mana mereka beroperasi. Dua jenis yang paling umum adalah Layer 4 dan Layer 7.

Load Balancing Layer 4 (Transport Layer)

Load balancer Layer 4 bekerja pada tingkat jaringan. Ia membuat keputusan perutean berdasarkan informasi dari lapisan transport, seperti alamat IP sumber/tujuan dan nomor port.

- Cara Kerja: Ia meneruskan paket data dari pengguna ke server tanpa memeriksa isi paket tersebut. Karena “tugasnya” lebih sederhana, prosesnya sangat cepat.

- Kelebihan: Sangat cepat dan efisien.

- Kekurangan: Tidak “sadar” akan konten aplikasi. Ia tidak tahu apakah yang diminta adalah gambar, video, atau data API. Semua jenis trafik TCP/UDP diperlakukan sama.

Load Balancing Layer 7 (Application Layer)

Ini adalah jenis load balancer yang lebih canggih dan umum digunakan untuk load balancer web app. Ia bekerja pada lapisan aplikasi, artinya ia dapat “membaca” dan memahami konten dari permintaan, seperti HTTP headers, cookies, dan URL.

- Cara Kerja: Karena memahami konteks permintaan, ia bisa membuat keputusan yang jauh lebih cerdas. Contohnya, mengarahkan semua permintaan untuk /video/* ke server yang dioptimalkan untuk streaming, sementara permintaan untuk /api/* diarahkan ke server aplikasi.

- Kelebihan: Sangat fleksibel, memungkinkan perutean yang kompleks, dan ideal untuk arsitektur microservices.

- Kekurangan: Sedikit lebih lambat dari Layer 4 karena harus memeriksa setiap paket, namun perbedaannya seringkali tidak signifikan untuk sebagian besar aplikasi.

Konsep Kunci dalam Ekosistem Load Balancing

Untuk memaksimalkan fungsinya, load balancer didukung oleh beberapa konsep penting:

- Health Checks: Bagaimana load balancer tahu sebuah server sedang “sakit”? Ia secara berkala mengirimkan permintaan kecil (ping) ke setiap server untuk memeriksa statusnya. Jika server gagal merespons beberapa kali, ia akan ditandai sebagai unhealthy dan dikeluarkan sementara dari rotasi hingga pulih kembali.

- Failover: Ini adalah tindakan otomatis yang terjadi ketika health check gagal. Load balancer akan segera mengalihkan semua trafik yang seharusnya ke server gagal ke server lain yang sehat. Inilah mekanisme di balik high availability.

- Session Persistence (Sticky Sessions): Bayangkan pengguna sedang mengisi keranjang belanja. Permintaan pertamanya dilayani oleh Server A. Jika permintaan keduanya (misalnya, menambahkan barang lain) dialihkan ke Server B, keranjang belanjanya bisa jadi kosong karena Server B tidak memiliki informasi sesinya. Session persistence memastikan bahwa semua permintaan dari satu pengguna selama satu sesi akan selalu diarahkan ke server yang sama, menjaga konsistensi data.

Tools Load Balancer yang Umum Digunakan

Ada banyak pilihan perangkat lunak load balancer, baik open-source maupun komersial. Berikut tiga yang paling populer:

- Nginx: Awalnya dikenal sebagai web server, Nginx juga memiliki kemampuan reverse proxy dan load balancing yang sangat andal dan performan. Konfigurasinya yang mudah menjadikannya pilihan favorit banyak orang.

- HAProxy: Ini adalah “spesialis” load balancer dan proxy. HAProxy terkenal karena performanya yang sangat tinggi, konsumsi sumber daya yang rendah, dan stabilitasnya yang teruji.

- Traefik: Load balancer modern yang dirancang untuk era cloud-native dan microservices. Keunggulan utama Traefik adalah kemampuannya untuk secara otomatis mendeteksi layanan baru (misalnya, kontainer Docker yang baru dijalankan) dan mengonfigurasi perutean tanpa intervensi manual.

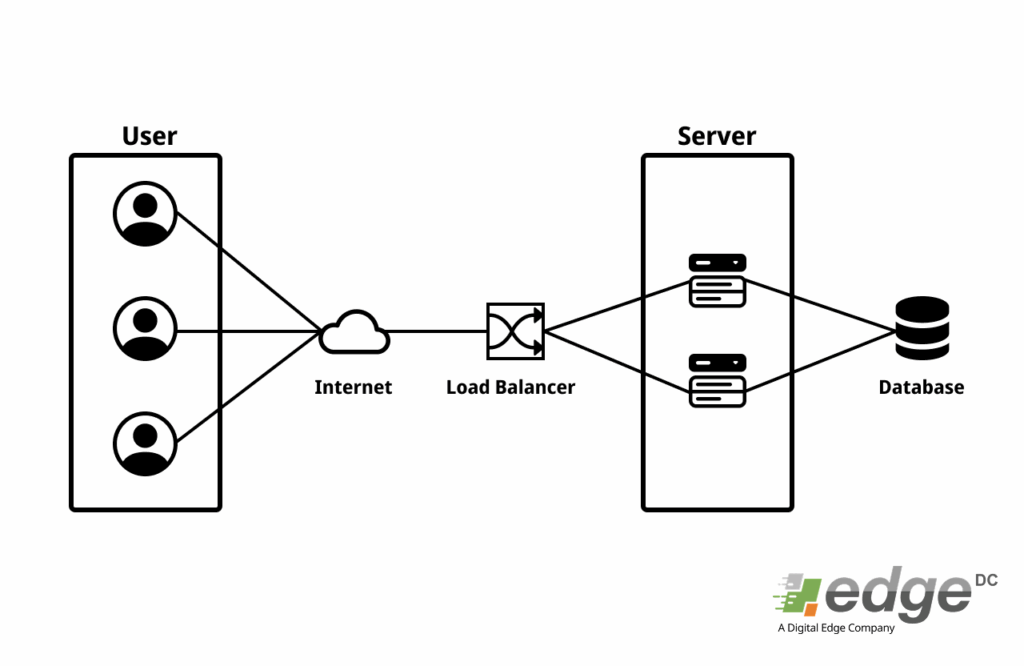

Contoh Arsitektur Sederhana untuk Skala Kecil–Menengah

Mari visualisasikan bagaimana semua ini bekerja bersama dalam sebuah arsitektur sederhana:

Kesimpulan

Load balancing bukan lagi sebuah kemewahan, melainkan komponen fundamental dalam merancang arsitektur aplikasi yang tangguh, cepat, dan skalabel. Dengan mendistribusikan beban kerja secara cerdas, ia tidak hanya menjaga performa aplikasi di level puncak tetapi juga memberikan jaring pengaman yang krusial untuk memastikan layanan Anda tetap berjalan bahkan ketika terjadi masalah pada salah satu server.

Memilih jenis load balancer yang tepat (Layer 4 atau Layer 7) dan mengkonfigurasi fitur seperti health checks dan session persistence akan menjadi kunci kesuksesan infrastruktur digital Anda.